25 结果

2025年5月20日 / AI Edge

LiteRT 已经过优化,通过高效利用 GPU 和 NPU 来提高移动设备上 AI 模型的性能和效率。现在不仅减少了代码量,还简化了硬件加速器选择流程,实现了最佳的设备端性能。

2025年5月20日 / Android

2025 年 Google I/O 大会重磅发布:聚焦跨 Google 平台构建内容并使用 Google DeepMind 的 AI 模型进行创新,重点关注旨在提高开发者效率的新工具、API 及功能,同时使用 Gemini、Android、Firebase 和 Web 创建 AI 驱动体验。

2025年5月13日 / TensorFlow

Keras Recommenders (KerasRS) 是新推出的库,旨在帮助开发者使用带有排名和检索基本模块的 API 构建推荐系统。该库不仅可以通过 pip 安装,还支持 JAX、TensorFlow 或 PyTorch 后端。

2025年5月9日 / Cloud

重温今年游戏开发者大会 (GDC) 的公告,探索 Gemma 和 Gemini 模型如何通过推出的 Gemma 3、Unity 插件及其在示例游戏中的应用程序,来帮助在游戏中构建 AI 体验以及在 Google Cloud 中使用生成式 AI 扩展游戏。

2025年4月30日 / Gemma

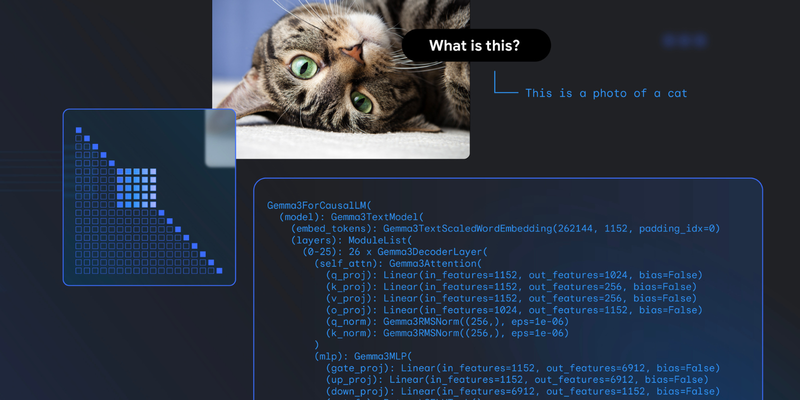

Gemma 3 的全新功能包括视觉语言能力,以及为提升内存效率和处理更长上下文而进行的架构改进,相较于之前的 Gemma 模型有了显著提升。

2025年3月3日 / Gemini

Google Colab 的数据科学代理由 Gemini 支持,此代理现在可根据简单的自然语言描述,生成完整且可运行的 notebook,从而实现数据分析任务自动化,让开发人员能将节省下的时间用于获取见解。

2025年2月25日 / Gemini

Gemini 2.0 Flash-Lite 现已在 Gemini API 中正式推出,可用于 Google AI Studio 中的生产用途,亦可供 Vertex AI 企业客户使用。2.0 Flash-Lite 在推理、多模态、数学和事实基准测试方面的性能均优于 1.5 Flash。对于需要较长上下文窗口的项目来说,2.0 Flash-Lite 是一种更具成本效益的解决方案,针对超过 128K Token 的提示简化了定价。

2025年2月13日 / Gemma

本文是构建基于 Gemma 2 的代理式 AI 系统的实用指南。代理式 AI 系统是指能够自主决策并使用外部工具实现目标的 AI 类型,该系统可以为虚构的游戏世界生成动态内容。

2025年2月5日 / Gemini

我们正在对 Gemini 2.0 模型系列进行重大更新,包括发布 Gemini 2.0 Flash,该模型具有可立即投入生产、速率限制更高、性能更强的和定价更简单的特点。开发者也可以立即开始测试更新后的 Gemini 2.0 Pro 实验性版本。此外,我们将在下周将推出名为 Gemini 2.0 Flash-Lite 的新模型,此模型专为大规模工作负载而设计。

2024年12月23日 / AI

了解如何使用 Google 的 Multimodal Embeddings API 构建可视化搜索工具,并探索如何将此技术应用于搜索图像、幻灯片等。